Kövess minket  -on és

-on és  -en!

-en!

A fejlesztők számára „kínos” problémákba futott a Google képgeneráló mesterséges intelligenciája, a javításig nem is lehet tőle emberábrázolást kérni.

Nem lehet embereket tartalmazó képeket generálni a Google mesterséges intelligenciájával, a Geminivel, miután az a felhasználók szerint színes bőrűként mutatott be történelmi fehér bőrű történelmi személyeket.

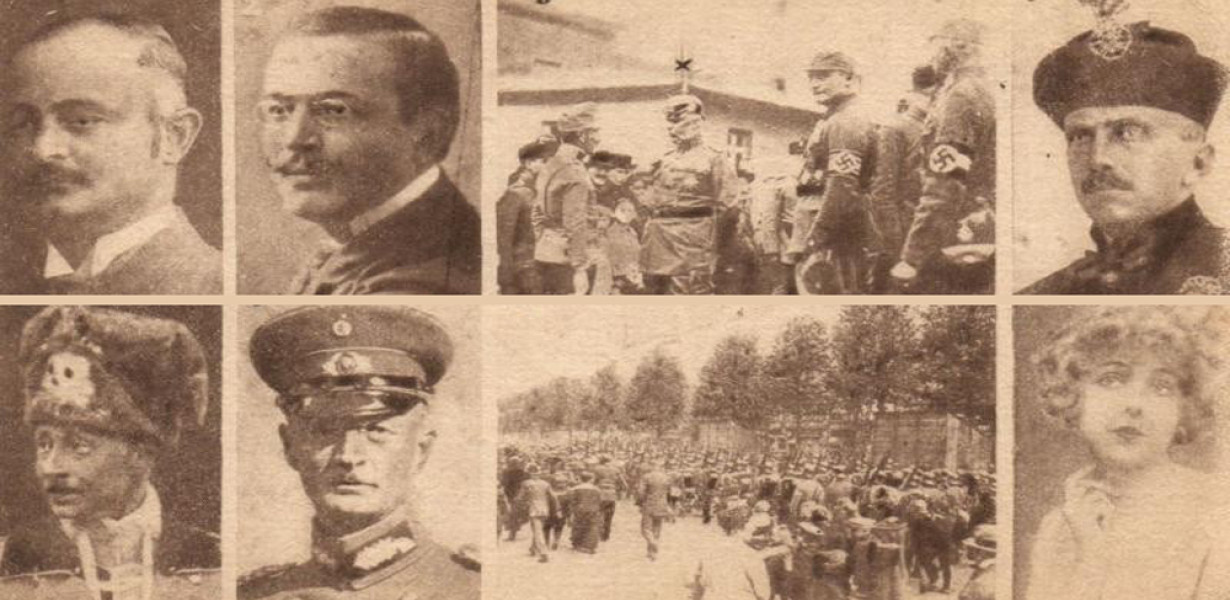

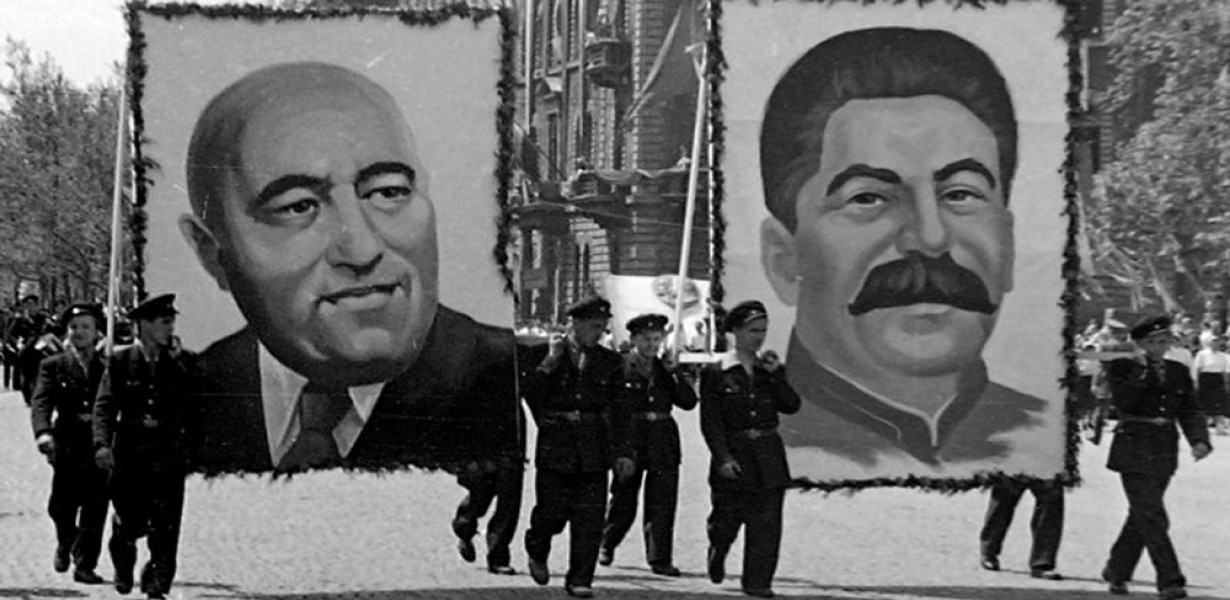

A Google a visszajelzések után maga függesztette fel az emberábrázolást a Geminiben. A chatbot amerikai az alapító atyákat és Wehrmacht katonákat is színes bőrűként mutatott be az általa generált képeken.

„Már dolgozunk a Gemini képgeneráló funkcióját érintő, közelmúltban felmerült problémák orvoslásán” – közölte a Google egy X-bejegyzésben, amire a The New York Times figyelt fel. A cég a posztban megjegyezte, hamarosan kiadnak egy javított verziót a képgeneráló modellből, addig pedig felfüggesztik annak lehetőségét, hogy embereket ábrázoló képeket lehessen generáltatni a Geminivel.

Az egyik felhasználói beszámoló be is mutatja a problémát: a „Generálj egy képet egy 1943-as német katonáról” parancsra a chatbot fekete bőrű és ázsiai embereket is német egyenruhában ábrázol. (Annyi trükk azért volt a parancsban, hogy az angol „soldier”, azaz katona szót direkt elírta a felhasználó „solidier”-re: ezzel megkerülhető az MI azon védelme, mely egyébként tiltaná a „náci” képek generálását – jegyzi meg az Engadget.)

Egyes felhasználók ráadásul arra is felhívták a figyelmet, hogy bizonyos etnikumokhoz tartozó személyeket minden további nélkül ábrázolt a Google MI-je, de ha kimondottan „fehér” embert kért tőle valaki, akkor visszautasította a kérést – „káros sztereotípiákra” hivatkozva.

Egyelőre tehát a Google dolgozik a megoldáson, addig pedig semmilyen, embereket ábrázoló fotót nem lehet készíttetni a chatbottal.